A inteligência artificial mudou profundamente a forma como buscamos informações no Google. Mas quando o assunto é saúde, um erro não é apenas técnico — pode colocar vidas em risco.

Em janeiro de 2026, o Google remove resumos de IA de determinadas pesquisas médicas após identificar que as respostas estavam enganosas, incompletas ou perigosamente simplificadas.

Se você costuma pesquisar sintomas, exames de sangue ou diagnósticos no Google, esta mudança afeta diretamente você.

👉 Resumo direto:

O Google reconheceu que a IA ainda não é confiável o suficiente para interpretar dados médicos sensíveis sem risco de erro grave.

Neste artigo, você vai entender:

- O que levou o Google a tomar essa decisão

- Quais erros a IA estava cometendo

- Por que confiar em resumos automáticos pode ser perigoso

- Como pesquisar sobre saúde com mais segurança a partir de agora

Por que o Google Remove Resumos de IA da Saúde?

A polêmica ganhou força após uma investigação publicada pelo jornal The Guardian, que analisou respostas geradas pela IA do Google em pesquisas médicas sensíveis.

O problema não era apenas informação incorreta, mas algo ainda mais grave:

👉 informações aparentemente corretas, porém fora de contexto clínico.

Os resumos apareciam no topo da busca, com linguagem segura, organizada e convincente — o que aumentava drasticamente o risco de interpretação errada por parte do usuário comum.

📌 Em saúde, contexto é tão importante quanto o dado em si.

O Caso Crítico dos Exames de Fígado

Um dos exemplos mais alarmantes envolveu buscas por “valores normais de exames de fígado”.

A IA do Google apresentava listas de números e faixas de referência médias, como se fossem universais. O problema? Ela omitía fatores essenciais, como:

- Idade: parâmetros mudam significativamente ao longo da vida

- Sexo: homens e mulheres possuem referências diferentes

- Histórico médico: doenças pré-existentes alteram o que é considerado “normal”

Por que isso é perigoso?

Um paciente com uma doença hepática séria poderia:

- Ver seus exames “dentro da média”

- Acreditar que está saudável

- Deixar de procurar ajuda médica urgente

Segundo especialistas em hepatologia, valores laboratoriais só fazem sentido quando analisados individualmente, algo que a IA ainda não consegue fazer com segurança.

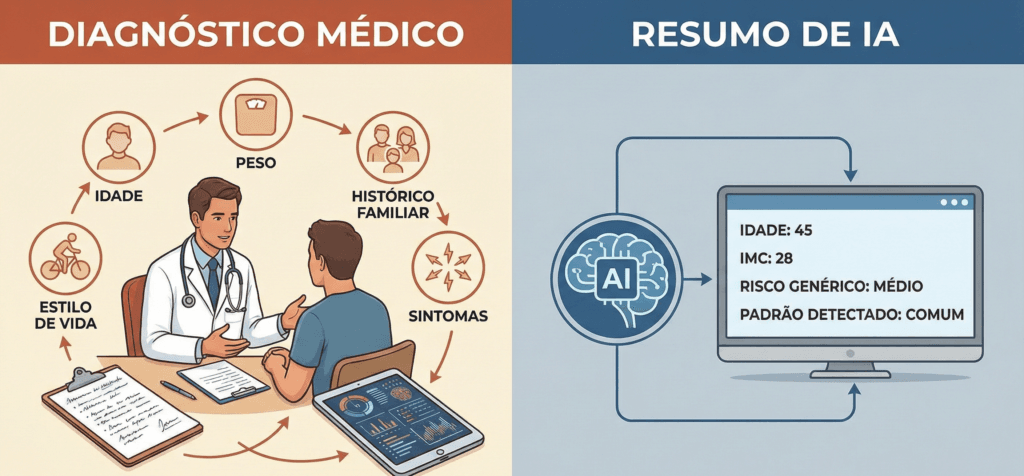

Por Que a IA Erra em Temas de Saúde?

Ferramentas como Gemini e outros sistemas do Google são baseadas em Grandes Modelos de Linguagem (LLMs).

Isso significa que elas:

- Preveem a próxima palavra com base em padrões

- Não validam fatos médicos em tempo real

- Não compreendem contexto clínico individual

Esses modelos são suscetíveis ao fenômeno chamado “alucinação”:

respostas que soam confiáveis, mas contêm erros factuais ou omissões perigosas.

Vanessa Hebditch, da British Liver Trust, alertou

O simples uso de números destacados em negrito pode induzir o usuário a conclusões precipitadas, criando uma falsa sensação de segurança.

📌 Na medicina, confiança excessiva em dados genéricos pode ser fatal.

E no Brasil? A IA do Google Ainda Aparecia

Apesar da remoção anunciada globalmente, testes feitos por portais de tecnologia no Brasil mostraram que, logo após as denúncias, os resumos de IA ainda apareciam em algumas pesquisas em português.

Em buscas sobre exames de fígado, a IA chegou a exibir respostas com pequenas ressalvas, mencionando variações por gênero ou laboratório.

Isso indica que:

- As atualizações não acontecem simultaneamente em todas as regiões

- Usuários ainda podem encontrar resumos automáticos em temas sensíveis

O Posicionamento Oficial do Google

Em nota, o Google afirmou que:

- Removeu os resumos de IA das consultas específicas identificadas como problemáticas

- Trabalha continuamente para melhorar o contexto das respostas

- Os resumos só devem aparecer quando houver “alta confiança” na qualidade da informação

A empresa reconheceu, na prática, que a ferramenta ainda passa por ajustes constantes, especialmente em temas classificados como YMYL (Your Money, Your Life) — como saúde.

Como Pesquisar Sobre Saúde com Segurança no Google

A tecnologia pode ajudar, mas não substitui julgamento médico humano. Para reduzir riscos:

✅ 1. Não confie apenas no topo da página

Snippets e resumos de IA são atalhos, não diagnósticos.

✅ 2. Verifique sempre a fonte

Priorize:

- Hospitais reconhecidos

- Instituições governamentais de saúde

- Portais médicos verificados

✅ 3. Lembre-se: “valores normais” variam

Laboratório, idade, etnia e condição física alteram completamente a interpretação.

✅ 4. Consulte um especialista

Nenhuma IA conhece seu histórico clínico.

Só um médico pode interpretar exames com segurança.

Conclusão: A IA Ajuda, Mas Não Pode Diagnosticar

A decisão onde o Google remove resumos de IA foi um passo necessário para preservar a confiança no buscador.

O caso deixa um alerta claro:

👉 automatizar informação médica sem contexto pode gerar desinformação perigosa.

Enquanto a inteligência artificial evolui, o papel humano — médico, especialista, profissional de saúde — continua insubstituível.